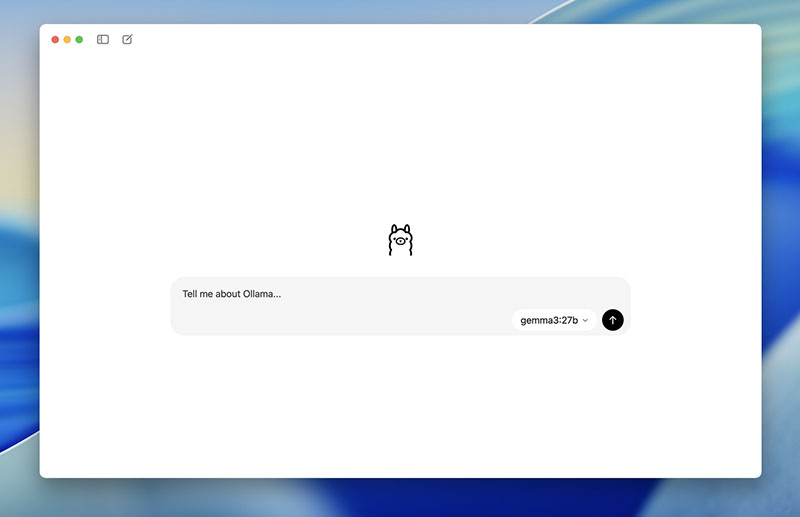

《iPhone News 愛瘋了》報導,你可能不知道,其實你的 Mac 已經快變成一台「不用連網的 ChatGPT」了。隨著 Ollama 0.19 預覽版 正式接入蘋果 MLX 機器學習框架,Mac 在執行本地 AI 大模型的速度,正在出現「體感級」的提升。

也就是說,未來你寫程式、跑 AI 助手,甚至生成內容,都可以完全在本機完成,而且更快、更私密。

「真正強大的科技,是在你不依賴任何人時,依然能完成一切。」

▋Mac 本地 AI 爆發:Ollama + MLX 帶來什麼改變?

這次 Ollama 最大的升級,是全面接入 Apple MLX 框架。這個框架是專為 Apple Silicon(M 系列晶片)設計,讓 AI 計算能更有效利用硬體資源。

▋效能提升的三大關鍵

- 統一記憶體優化:減少資料搬移,速度更快

- 快取效能提升:降低延遲,提高流暢度

- NVFP4 壓縮格式:大幅降低記憶體使用

這些優化的結果就是——更快的回應、更低的資源消耗。

▋M5 Mac 專屬加速:AI 直接用神經網路引擎

如果你用的是最新的 M5 Mac,這次升級會更有感。

▋NPU 加速帶來的實際差異

- 每秒生成 token 數提升

- 首字回應速度更快(降低等待感)

- 整體互動更接近即時對話

簡單說,就是從「等 AI 回答」,變成「像聊天一樣自然」。

▋實際使用差在哪?開發者體驗全面升級

這次升級對一般用戶可能還不明顯,但對開發者來說是巨大改變。

▋常見 AI 工具體驗提升

- OpenClaw(龍蝦)私人助理:回應更快、更流暢

- Claude Code:程式生成效率提升

- Codex 類工具:即時補全更準確

很多開發者實測指出,延遲下降可達 30%~50%,尤其在長文本生成時差異更明顯。

▋硬體門檻曝光:不是每台 Mac 都跑得動

但這裡有一個現實——不是所有人都能用。

▋目前限制條件

| 條件 | 需求 |

|---|---|

| 記憶體 | 至少 32GB 統一記憶體 |

| 模型支援 | Qwen3.5(350 億參數) |

| 版本 | Ollama 0.19 預覽版 |

這也代表,目前還是偏向進階用戶與開發者的功能。

▋MLX 是什麼?為什麼 Apple 要做這件事

MLX 是 Apple 專為自家晶片打造的開源機器學習框架,支援 Python 與 Swift,讓開發者可以直接在裝置上運行大型語言模型。

▋核心優勢一次看

- CPU + GPU 高效協同運算

- 針對 Apple Silicon 深度優化

- 強調本地 AI(on-device AI)

這其實也呼應 Apple 一直以來的策略:把 AI 留在你的裝置,而不是送上雲端。

▋這代表什麼?Mac 正在變成「AI 個人電腦」

當你可以在 Mac 上直接跑 350 億參數模型,而且速度還夠快,這代表一件很關鍵的事:

未來 AI 不再只是雲端服務,而是你電腦的一部分。

「當運算回到本地,掌控權才真正回到你手上。」

《iPhone News 愛瘋了》表示,當 Mac 開始能獨立運行強大的 AI 模型,你還會把資料交給雲端嗎?還是,你會選擇一台真正屬於自己的 AI 電腦,重新定義「隱私」與「效率」的平衡?

● Apple 相關內容:Mac 本地 AI 模型加速方法、Ollama MLX 效能提升、Apple MLX 機器學習框架介紹