上個月,「蘋果宣布擴大對兒童的保護,利用科技幫助受虐待兒童」。在收到多方的意見和反饋後,蘋果公司今天宣布,推遲上個月宣布的兒童安全功能的推出。

蘋果在一份聲明中說:「上個月,我們宣布了一些功能計劃,旨在幫助保護兒童免受利用通訊工具招募和剝削他們的掠奪者的侵害,並限制兒童性虐待材料的傳播。根據用戶、宣傳團體、研究人員和其他方面的反饋,我們決定在未來幾個月內花更多時間收集意見並進行改進,然後再發布這些極其重要的兒童安全功能。」

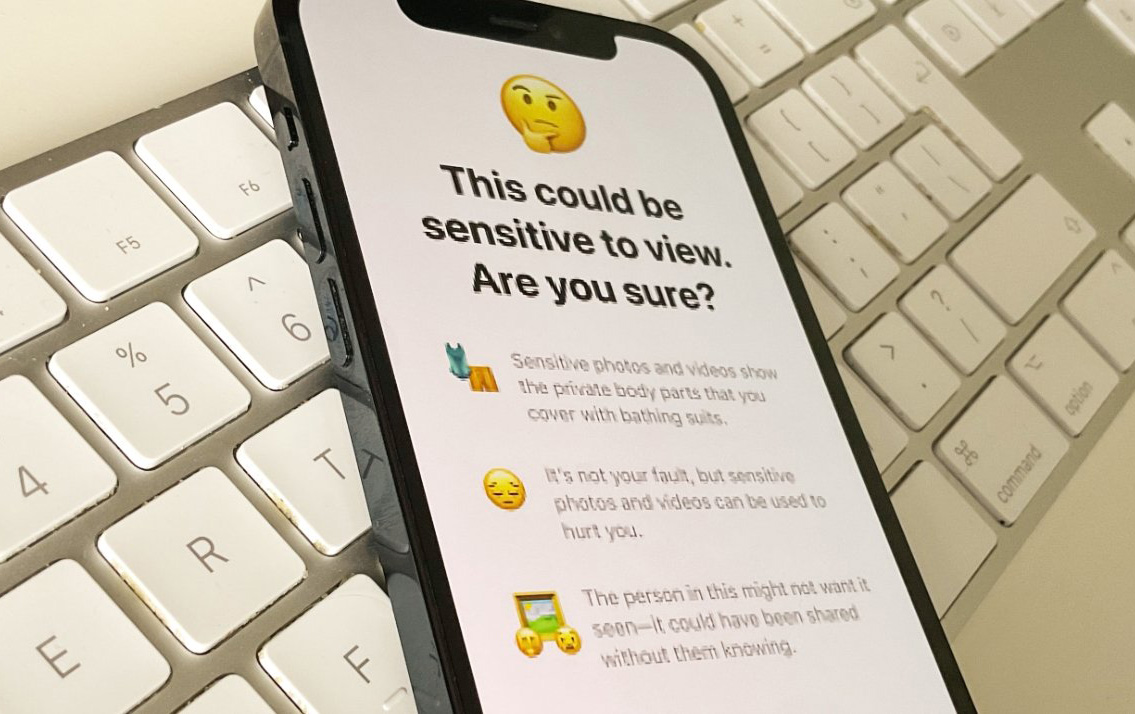

計劃中的功能包括掃描用戶的 iCloud 照片庫中的兒童性虐待材料 (CSAM),在接收或發送色情照片時警告兒童及其父母的通訊安全,以及擴大 Siri 和搜尋中的 CSAM 指導。

蘋果公司證實,用戶、非營利組織和宣傳團體、研究人員和其他方面對這些計劃的反饋促使其推遲,以使公司有時間作出改進。

這些功能公佈後,受到了廣泛的個人和組織的批評,包括安全研究人員、隱私舉報人愛德華-斯諾登、電子前沿基金會 (EFF)、Facebook 的前安全主管、政治家、政策團體、大學研究人員,甚至一些蘋果員工。此後,蘋果公司努力消除誤解,並通過發布詳細訊息、分享常見問題解答、各種新文件、對公司主管的採訪等方式來安撫用戶。

這套兒童安全功能原本定於在美國隨著 iOS 15、iPadOS 15、watchOS 8 和 macOS Monterey 的更新而首次亮相。現在還不清楚蘋果公司計劃何時推出這些 至關重要 的功能,但蘋果公司似乎仍打算發布這些功能。

發表留言