蘋果聯手加利福尼亞大學的研究人員,推出了自家的基於人工智慧的圖像編輯模型,該模型被稱為“MGIE”,代表 MLLM 引導圖像編輯,任何人都可以嘗試使用。

MGIE 模型介紹

該模型被命名為”MGIE”,代表 MLLM 引導圖像編輯,允許用戶根據自然語言指示來編輯圖像。

它利用多模態大型語言模型(MLLMs),結合文字、照片和視訊等各種訊息,以理解並生成類似人類的語言。

MLLMs 的應用

儘管關於 MLLM 的研究在理解和生成圖像方面取得了令人期待的成果,但迄今為止還未被廣泛應用。

MGIE 在 2024 年的國際學習表示研討會上發表了一篇論文。該論文展示了 MGIE 如何提高自動指標和人工評估,同時保持競爭力的推論效率。

MGIE 的操作方式

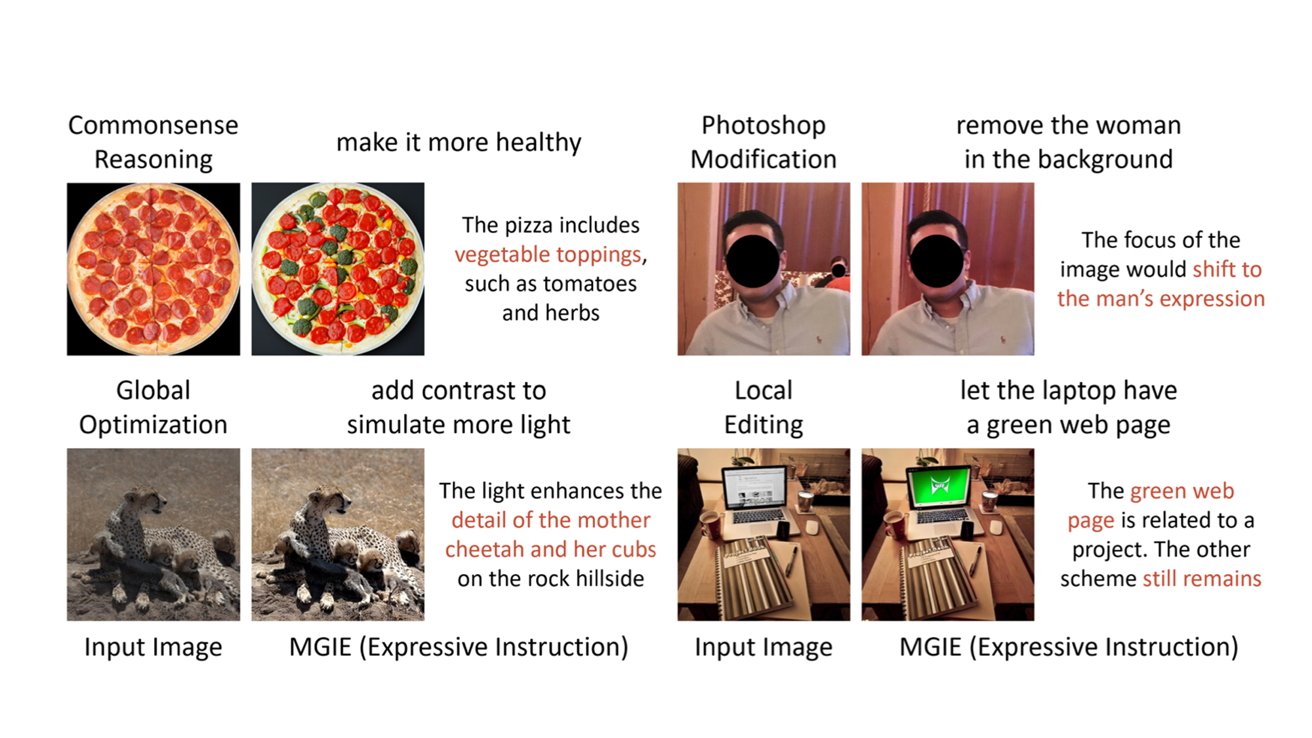

MGIE利 用 MLLMs 從用戶輸入中獲得豐富的指示。Venture Beat 提供了一個例子:用戶可以告訴MGIE“讓天空更藍”,而MGIE將解釋為“增加天空區域的飽和度 20%”。

然後,一旦從自然語言輸入中獲得指示,它就會生成圖像的編輯版本。它可用於創建各種編輯,從調整顏色到生成或刪除圖像的部分。

MGIE 的開源性

MGIE 是開源的,任何人都可以在 GitHub 上嘗試。GitHub 頁面允許用戶獲取代碼、數據和預訓練模型。

圖像生成的速度將根據硬體性能而有顯著變化。此外,這類模型對 RAM 的需求極大。

蘋果的AI助手功能

蘋果在幕後一直在致力於其人工智慧輔助功能。今年一月,iOS 17.4 beta 的代碼表明蘋果正在開發一個新的基於 AI 的 Siri 版本。

由於分析師大聲宣稱蘋果在生成式人工智慧實現方面落後於 Meta、Google 和 Microsoft,蘋果的股價最近有所下跌。

對於為何在手機、平板、智慧手表或 VR 頭顯方面不是第一,而在生成式人工智慧方面卻是,目前尚不清楚。

發表留言